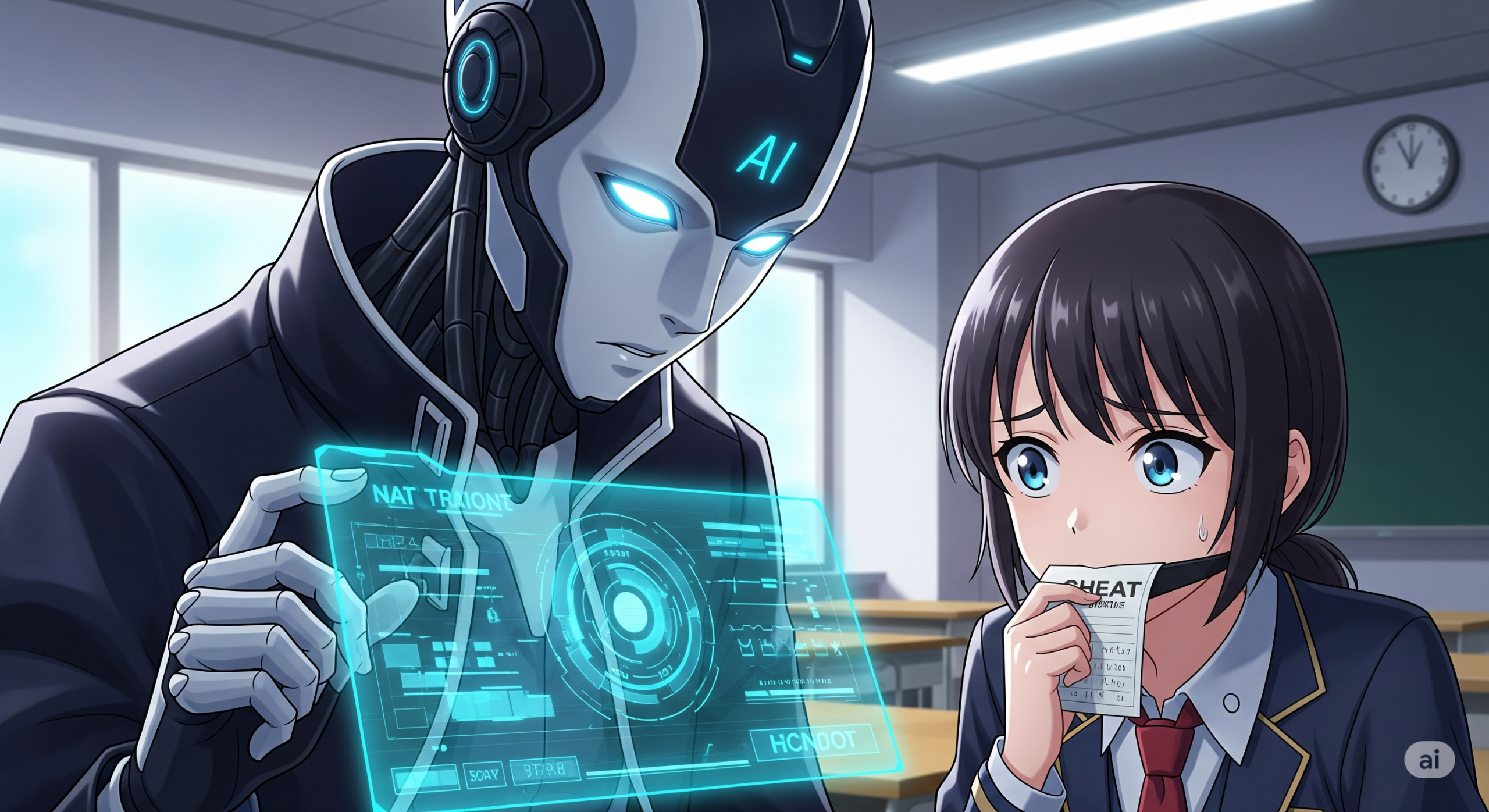

AIの進化とカンニングの新たな手口

近年、AI技術、特に画像認識能力の進化は目覚ましいものがあります。例えば、展覧会で撮影した建物の写真をAIに読み込ませるだけで、瞬時にその建物の名前を教えてくれるほどです。まるでAIが「目」を手に入れたかのようですね。しかし、この進化は同時に、新たな問題も引き起こしています。それは、AIを悪用したカンニングです。

中国の高考(Gaokao)とAI画像認識機能の一時停止

中国では、日本における大学入学共通テストに相当する「高考(Gaokao)」という全国統一大学入試が毎年行われます。この試験は、中国の高校生にとって人生を左右する非常に重要なものです。なんと、毎年1000万人以上が受験するんですよ!

先日、中国でメジャーな生成AIアプリにおいて、画像認識機能が一斉に使えなくなるという出来事がありました。実はこれ、高考の期間中に合わせて行われた措置だったんです。なぜでしょうか?

理由は簡単。受験生が試験問題を撮影し、AIアプリに読み込ませて答えを得るというカンニング行為を防ぐためです。企業側が自主的に画像認識機能を停止することで、不正行為を抑止しようとしたんですね。

AIは入試問題を解けるのか?驚きの実力

「入試問題をAIに見せて正答を得ることなんてできるの?」と疑問に思う方もいるかもしれません。しかし、最近のAIは驚くほど進化しており、多くの問題で高い確率で正答を出すことができるんです。例えば、大学入試センターが公開している過去問をAIに解かせてみたところ、かなりの精度で正解していました。

もちろん、100%完璧ではありませんが、AIの進化はカンニングの手口を高度化させ、試験の公平性を脅かす可能性を秘めていることは間違いありません。

このニュースから私たちが学ぶべきこと

中国の事例は、AI技術の進化と倫理的な問題、そして教育現場における対策の重要性を示唆しています。AIは便利なツールである一方、使い方によっては不正行為に利用される可能性があることを忘れてはなりません。

私たち一人ひとりがAI技術の正しい使い方を理解し、倫理観を持って利用することが大切です。また、教育機関は、AI技術の進化に対応した試験制度や不正行為対策を検討する必要があります。

まとめ

今回の中国の事例は、AI技術の進化がもたらす可能性とリスクを改めて認識する良い機会となりました。AIは私たちの生活を豊かにする素晴らしいツールですが、同時に倫理的な問題や不正利用のリスクも抱えています。私たちは、AI技術の恩恵を最大限に享受するために、常に倫理観を持ち、正しい使い方を心がける必要があります。

ぜひ、今回の記事をきっかけに、AI技術の倫理的な側面について考えてみてください。また、ご自身の周りの教育機関におけるAI対策について調べてみるのも良いでしょう。AIと共存する未来のために、私たち一人ひとりができることを考えていきましょう。

コメント